Cuando una foto “inocente” entra en una IA: la advertencia de la AEPD y su impacto en las aulas

Publicado: 15 enero 2026 a las 6:00 pm

Categorías: Artículos

[responsivevoice_button buttontext="Escuchar la noticia" voice="Spanish

Latin American Female"]

Por Silvia Prieto Preboste

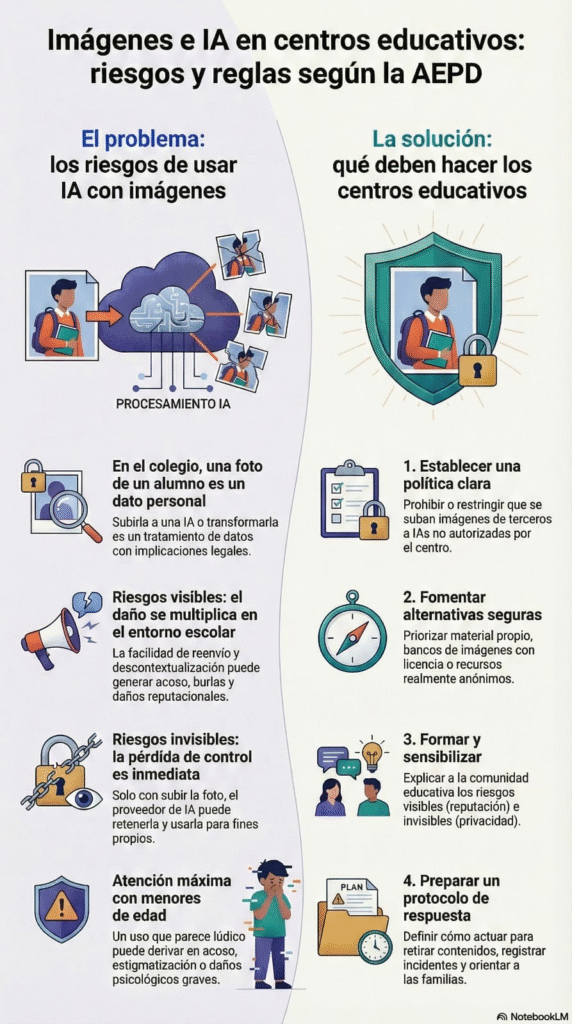

Las herramientas de inteligencia artificial capaces de generar o modificar imágenes se han colado en la vida cotidiana a una velocidad difícil de igualar. Bastan unos segundos para convertir una foto en un avatar, “poner a alguien en otra escena”, animar un rostro o recrear una situación con apariencia realista. El problema, advierte la Agencia Española de Protección de Datos (AEPD), es que ese gesto aparentemente banal puede abrir la puerta a daños muy reales: algunos se ven de inmediato y otros ocurren sin que nadie los perciba.

Con ese foco, la AEPD ha publicado en enero de 2026 una guía específica sobre el uso de imágenes de terceros en sistemas de inteligencia artificial y sus “riesgos visibles e invisibles”, en la que recuerda una idea básica: si una persona es identificada o identificable en una imagen, estamos ante un dato personal, también cuando el contenido ha sido generado o modificado mediante IA. ([AEPD][1])

Una imagen identificable es un dato personal, aunque esté “transformada”

La guía parte de una definición amplia y muy relevante para el día a día: una persona puede ser identificable no solo por el rostro, sino también por la voz, el cuerpo, los gestos, la vestimenta, tatuajes, el entorno o las relaciones que aparecen en la escena, e incluso por la combinación de varios elementos, aunque la imagen original se haya alterado. No hace falta que aparezca el nombre para que exista tratamiento de datos personales si la identificación es posible, aunque sea dentro del contexto en el que se difunde el contenido.

A partir de ahí, la AEPD fija otra premisa práctica: subir una foto o un vídeo a un sistema de IA, reenviarlo a plataformas, transformarlo o generar contenido visual nuevo “a partir” de esa imagen es un tratamiento de datos personales. Y lo es con independencia de que la finalidad sea lúdica, educativa o parezca trivial. En muchos casos, además, se está usando la imagen de una persona sin su conocimiento para que sea tratada por un servicio de Internet, que puede realizar tratamientos adicionales —como conservación, gestión técnica o finalidades propias— al margen de la intención del usuario.

Riesgos visibles: lo que ocurre cuando la imagen se comparte (y se descontrola)

La guía ordena el análisis de los riesgos “visibles” recuperando criterios clásicos de protección de datos aplicables a la difusión de imágenes, y subraya que siguen siendo válidos aunque el contenido sea sintético o esté generado por IA. De hecho, desde el punto de vista de la persona afectada, el daño puede ser equivalente —o incluso mayor— que con una foto o vídeo real, sobre todo cuando el resultado es verosímil y circula fuera del control inicial.

Entre esos criterios, la AEPD pone el acento en la “expectativa razonable” y la legitimación del uso concreto: que una fotografía haya estado en un grupo de mensajería o se haya compartido una vez no equivale a una autorización general para cargarla en una IA, transformarla, generar variantes o difundir el resultado. Cuanto más se aleja el uso del contexto original y menor es el control de la persona sobre ese uso, más exigente debe ser la base de legitimación y mayor el nivel de riesgo.

El alcance y la facilidad de difusión son otro factor determinante. En mensajería, el salto de un grupo a otros grupos, las capturas de pantalla y las republicaciones convierten cualquier contenido en potencialmente masivo. A esto se suma la persistencia: aunque existan mecanismos para retirar publicaciones, no siempre garantizan la eliminación total de copias o reenvíos, lo que reduce la reversibilidad del daño.

La guía destaca también dos escenarios de alto riesgo. El primero es la sexualización o la creación de contenido íntimo sintético, por su gravedad y por el potencial de chantaje, acoso o difusión no controlada. El segundo es la atribución de hechos no reales con efectos reputacionales: cuando la IA permite fabricar escenas creíbles que nunca ocurrieron, el impacto sobre relaciones personales, posición social o profesional puede ser muy significativo. A ello se añade la descontextualización, cuando la imagen se presenta fuera de su marco original o acompañada de textos o comentarios que alteran su significado.

Por último, la AEPD remarca que el “umbral de prudencia” debe ser máximo cuando la persona afectada es vulnerable, en especial si se trata de menores. Incluso un uso que pretende ser inocente puede desencadenar acoso o estigmatización. Y, al medir el impacto, incluye explícitamente el daño en el contexto educativo, junto con daños psicológicos, suplantación de identidad u otros efectos negativos relevantes.

Riesgos invisibles: lo que sucede aunque nadie publique nada

La parte más diferencial del documento es la que aborda los riesgos “menos visibles”: aquellos que se producen por el mero hecho de subir una imagen o un vídeo a un sistema de IA, incluso si el resultado no se publica. La guía insiste en que estos riesgos derivan del funcionamiento normal de muchos servicios y suelen pasar inadvertidos para usuarios y personas afectadas, aunque no exista mala intención.

El primer riesgo es la pérdida efectiva de control cuando interviene un tercero tecnológico. Al cargar el archivo, el contenido deja de estar bajo el control exclusivo de quien lo sube —y, por supuesto, de la persona retratada— y pasa a ser tratado por un proveedor externo que decide cómo se procesa. A partir de ahí, aparece la retención técnica y las copias no visibles: muchos sistemas conservan temporalmente materiales para procesarlos, gestionar errores o mantener copias de seguridad, algo que la persona afectada no puede verificar con facilidad.

Otro elemento es la ampliación del perímetro de acceso. El tratamiento no se limita a una sola entidad: pueden intervenir infraestructuras de nube, almacenamiento, herramientas de seguridad o moderación, e incluso personal técnico de soporte, lo que incrementa la exposición potencial del dato. Además, el proveedor puede tratar las imágenes para finalidades añadidas —seguridad, detección de abusos, evaluación de calidad, mejora del servicio— y durante el procesamiento pueden generarse metadatos e inferencias internas, como análisis automáticos para detectar rostros o rasgos básicos, que dejan rastro aunque el resultado parezca inofensivo.

La guía alerta también del riesgo de identificación persistente en herramientas diseñadas para que una misma persona aparezca “coherente” en múltiples imágenes o vídeos generados a partir de una sola fotografía. En esos casos, la foto funciona como una base estable para recrear al sujeto en distintas escenas, aumentando el riesgo de reidentificación, pérdida de control y usos posteriores no previstos. Se suma la asimetría informativa: la persona afectada suele no saber qué sistema se utilizó, qué ocurrió con su imagen, cuánto tiempo se conservó o a quién dirigirse, lo que dificulta en la práctica ejercer derechos como acceso, supresión u oposición. Y, aunque no sea lo más frecuente, existen riesgos de exposición por errores o incidentes de seguridad.

Finalmente, la AEPD describe un “efecto multiplicador”: una vez dentro del sistema, generar variantes es barato y rápido, lo que aumenta la probabilidad de que en alguna iteración aparezcan resultados lesivos y explica por qué muchos daños visibles se apoyan en riesgos técnicos previos que no eran perceptibles al inicio. Conclusión: subir imágenes de terceros a sistemas de IA “no es un acto neutro”, incluso sin intención de causar daño ni difusión posterior.

El ámbito educativo: un perfect storm para los riesgos

Si hay un entorno donde la advertencia cobra un sentido inmediato es la educación. En los centros se trabaja a diario con imágenes: orlas, excursiones, actividades, proyectos, plataformas educativas, redes sociales institucionales y grupos de mensajería de familias o alumnado. Y, en paralelo, crece el uso de IA para crear materiales didácticos, dinamizar tareas o producir piezas visuales atractivas. Ese cruce multiplica los riesgos descritos por la AEPD por tres razones.

La primera es contextual: una imagen escolar identifica con facilidad incluso aunque no se vea el rostro. Uniformes, patios, aulas, compañeros, eventos o carteles del centro pueden hacer a un menor identificable en su comunidad. La segunda es social: la difusión en grupos cerrados es, en la práctica, permeable; basta un reenvío para que un contenido salga del circuito. La tercera es asimétrica: un alumno o una familia rara vez conocerán qué herramienta de IA se usó, qué hizo el proveedor con la imagen o cómo pedir la eliminación efectiva, lo que conecta directamente con los riesgos invisibles que describe la guía.

La AEPD, además, llama la atención de forma expresa sobre dos aspectos que en educación son especialmente sensibles. Por un lado, el umbral de prudencia debe ser máximo con menores, porque un uso aparentemente inocente puede derivar en acoso o estigmatización. Por otro, al hablar de impacto, incluye de manera explícita el daño en el “contexto educativo”, junto con la suplantación de identidad y los daños psicológicos. En la práctica, esto significa que un deepfake, un montaje “gracioso” o un avatar generado a partir de una foto real puede convertirse en un problema de convivencia, reputación y protección del menor, incluso si empezó como una broma.

A ello se suma una idea que interpela directamente a rutinas escolares muy normalizadas: que una fotografía esté en un grupo de clase o se haya compartido en un canal del centro no equivale a una autorización general para cargarla en herramientas de IA, transformarla o generar variantes. Trasladado al aula, esto afecta tanto al alumnado como al profesorado: usar la foto de un compañero para “ponerlo en otra escena”, crear un vídeo sintético o convertirlo en personaje de una historia puede implicar un tratamiento de datos personales para el que no existe base legítima suficiente, especialmente si interviene un proveedor externo con finalidades y retenciones que no controlamos.

Hacia una cultura de “IA responsable” en los centros

Más que una llamada al miedo, la guía funciona como una pauta de prudencia. La IA puede ser una aliada educativa, pero el documento de la AEPD obliga a separar con claridad dos planos. Uno es el de la creatividad y la innovación pedagógica. Otro es el de la gestión de imágenes de personas reales, y especialmente de menores, donde los riesgos visibles e invisibles exigen controles más estrictos y decisiones organizativas.

En ese sentido, el mensaje que se desprende de la guía es que la prevención debe empezar antes del incidente: con políticas claras sobre qué herramientas están autorizadas, formación para profesorado y alumnado sobre el consentimiento y la expectativa razonable, y alternativas técnicas que eviten subir imágenes identificables a servicios externos cuando no sea imprescindible. También implica asumir que “no publicar” no equivale a “no tratar”: el riesgo puede estar ya en el simple acto de cargar el archivo.

Fuente: https://exitoeducativo.net/foto-advertencia-de-la-aepd-impacto-en-aulas/

Deja un comentario